Il sistema operativo mobile iOS 13 porta con sé anche una funzione molto interessante che consente alle applicazioni di catturare scatti diversi da diverse fotocamere dello stesso dispositivo, compreso l'audio.

Qualcosa di simile ha funzionato sul Mac sin dai tempi del sistema operativo OS X Lion. Ma fino ad ora le prestazioni limitate dell’hardware mobile non lo hanno consentito. Tuttavia, con l'ultima generazione di iPhone e iPad, anche questo ostacolo cade, e iOS 13 può quindi registrare contemporaneamente da più fotocamere su un unico dispositivo.

Potrebbe essere ti interessa

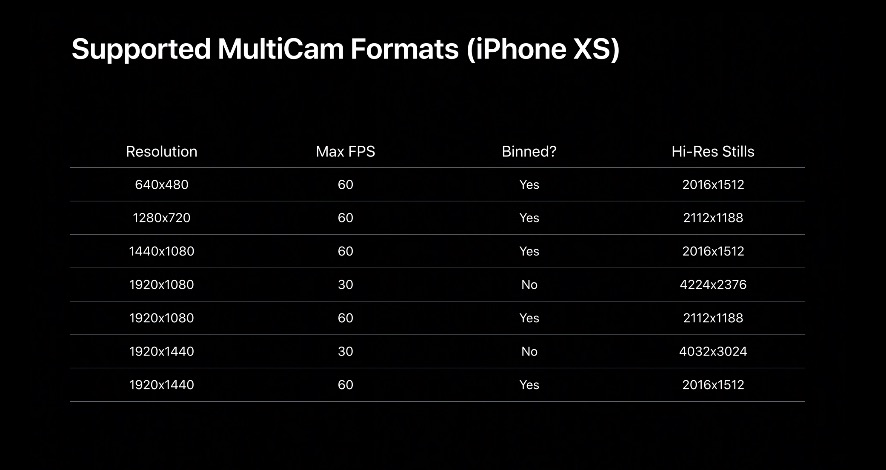

Grazie alla nuova API, gli sviluppatori potranno scegliere da quale telecamera l'applicazione riceverà quale input. In altre parole, ad esempio, la fotocamera anteriore può registrare video mentre quella posteriore scatta foto. Questo vale anche per il suono.

Parte della presentazione alla WWDC 2019 è stata una dimostrazione di come un'applicazione può utilizzare più record. L'applicazione potrà così registrare l'utente e allo stesso tempo registrare lo sfondo della scena con la fotocamera posteriore.

Registrazione simultanea di più telecamere solo sui nuovi dispositivi

Nell'applicazione Foto era quindi possibile scambiare semplicemente entrambi i record durante la riproduzione. Inoltre, gli sviluppatori avranno accesso alle fotocamere TrueDepth anteriori dei nuovi iPhone o all'obiettivo grandangolare o teleobiettivo sul retro.

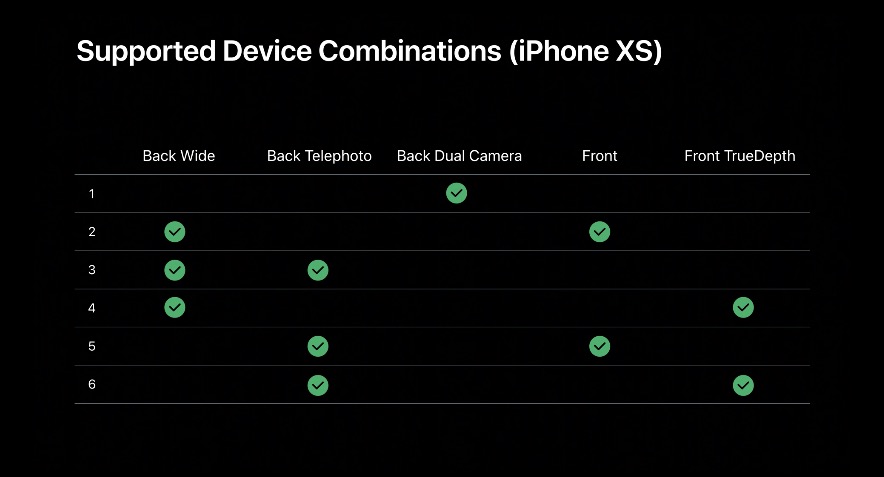

Questo ci porta alla limitazione che avrà la funzione. Attualmente sono supportati solo iPhone XS, XS Max, XR e il nuovo iPad Pro. Nessun altro dispositivo nuovo funzionalità in iOS 13 non possono ancora usarlo e probabilmente non saranno nemmeno in grado di farlo.

Inoltre, Apple ha pubblicato elenchi di combinazioni supportate. Ad un esame più attento si può concludere che alcune restrizioni non sono tanto di natura hardware quanto di natura software e Cupertino blocca deliberatamente l'accesso in alcuni luoghi.

A causa della capacità della batteria, iPhone e iPad potranno utilizzare solo un canale di riprese multi-camera. Al contrario, il Mac non ha tale limitazione, nemmeno i MacBook portatili. Inoltre, la funzionalità in primo piano probabilmente non farà nemmeno parte dell'app Fotocamera di sistema.

La fantasia di uno sviluppatore

Il ruolo principale sarà quindi l'abilità degli sviluppatori e la loro fantasia. Apple ha mostrato ancora una cosa, ovvero il riconoscimento semantico dei segmenti di immagine. Sotto questo termine non si nasconde altro che la capacità di riconoscere una figura in un'immagine, la sua pelle, i capelli, i denti e gli occhi. Grazie a queste aree rilevate automaticamente, gli sviluppatori possono poi assegnare diverse parti del codice, e quindi delle funzioni.

Potrebbe essere ti interessa

Al workshop della WWDC 2019 è stata presentata un'applicazione che filmava lo sfondo (circo, telecamera posteriore) parallelamente al movimento del personaggio (utente, telecamera frontale) ed era in grado di impostare il colore della pelle da clown utilizzando regioni semantiche .

Quindi non possiamo che attendere con ansia come gli sviluppatori utilizzeranno la nuova funzionalità.

Fonte: 9to5Mac